浏览次数:1021 发布时间:2019-10-11 10:08:55

今年阅兵的两个大杀器——DF-17和DF-41被广泛关注,然而文摘菌却从三个无人作战方队中,看到了一丝不寻常。

无人作战与人工智能的发展密不可分。据《经济学人》报道,美国国防部在2月份的第一份AI战略文档中宣布:“人工智能即将改变未来战场”,2018年夏季,五角大楼成立了联合人工智能中心(JAIC),今年3月,国家人工智能安全委员会首次会议开幕。

在2020年度预算中,五角大楼在人工智能上投入了近10亿美元,而涉及无人驾驶和自主能力的预算更是高出了四倍。

在越南,美军初试用“算法”打仗

1970年的Igloo White行动被认为是未来战争的预演。

海军战机在丛林中低空俯冲,将一些设备丢入下方树冠中。

这些设备,有些是用来监听游击队的脚步声或卡车的点火声的麦克风,另有一些是记录地面微小振动的地震探测器,这其中最新奇的是嗅觉传感器,它可以嗅出人类尿液中的氨。

这些成千上万的电子器件及时地将捕获的数据回传到无人机和电脑上。数分钟之内,战机就将地毯式轰炸由算法指定的网格区域。

美国试图以上面这些方式来切断从老挝到越南的胡志明小道,然而并未取得成功,据说越南人训练猴子将这些传感器全部破坏了。在这些行动中,美军每年花费约10亿美元(约合今天的73亿美元),每摧毁越方一辆卡车需花费10万美元(约合今天的73万美元),然而这些并未有效阻止越北势力的渗透。

但是将“算法”用于战争的魅力并未因此褪色。用传感器收集数据,再用比以往处理能力更强的算法进行处理,并根据处理结果比敌人更快地采取行动这一战略,成为世界各大国家的军事思想核心。如今,人工智能(AI)的发展让这种观念更加深入人心。

机器的崛起

类似的事情也在中国发生:中国希望在2030年之前在人工智能方面领先世界;而俄罗斯的总统弗拉基米尔·普京则有一句名言“谁成为这一领域(人工智能)的领导者,谁就会成为世界的统治者”。

AI是一个广义且模糊的术语,涵盖了从1950年代最初的规则遵循系统到现代的基于概率的机器学习(计算机通过自学来解决任务)的各种技术。矛盾的是,如果任由人工智能技术以当前的速度和形势发展下去,那么很可能因为人工智能自身的不透明性而使得现代战争的局势扑朔迷离。

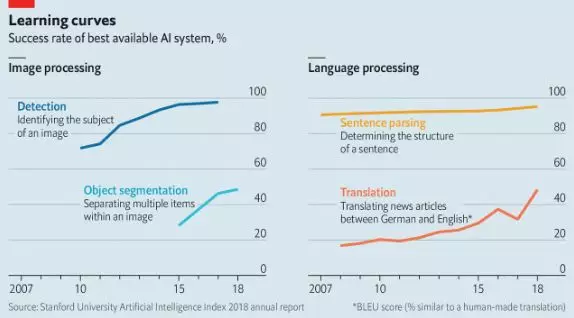

深度学习是一种特别流行且有效的机器学习方法,涉及多层模仿大脑的神经网络,其目前已被证明非常擅长处理各种任务,例如翻译、图像识别和游戏(参见图表)。

宾夕法尼亚大学的Michael Horowitz将AI比作内燃机或电力,来说明其用途的广泛。他将人工智能在军事的应用分为三类:一种是允许机器在无人监督的情况下运行,另一种是处理和解释大量数据,第三种是协助甚至直接指挥和控制战争。

就战场而言,自动化的吸引力是显而易见的——机器人比人类更便宜、更坚强且更易进行扩展。但是,一台能够在战场上运动甚至战斗的机器必须拥有足够的智能来执行任务,不够智能的无人机无法在战斗中长期存活;更糟糕的是,一个无知的持枪机器人很可能酿成一场事故。

所有的这些都要求人工智能赋予机器必要的技能,包括一些简单技能——感知和导航,以及其它更高级的技能,例如与其他军事人员进行合作。

结合了这些能力的智能机器可以完成个人无法完成的任务。伦敦国王学院的Kenneth Payne介绍说:“在模拟空战中,人工智能系统已经胜过了经验丰富的军事飞行员。”

今年二月,美国国防部高级研究计划局(DARPA)的“蓝天思维”部门(blue-sky-thinking branch)对能够在“高威胁”环境下协作的最强大的六个无人机群进行了最新测试,这其中甚至包括无人引导的情形。

尽管如此,大多数此类系统的智能都表现出了狭窄而脆弱的特性——在定义明确的环境中能很好地执行一项任务,但在不熟悉的环境中很容易失败。

因此,现有的自动武器要么是可攻击雷达的巡航导弹,要么是用于防御舰船和基地的速射炮。这些武器都很有用,但不是革命性的,也没有用到近年来出现的高级机器学习技术。

需要不断提高的“智能”武器

不要认为AI只能做一些战场上的苦力活,机器人,杀手亦或者是任何事物,都必须对它们“看到”的东西作出反应。

但是对于许多诸如间谍飞机和卫星这样的军事平台,关键是要发回原始数据,这些原始数据只有经过处理才可能变成有用的情报。现在,这种情报比以往任何时候都多,仅在2011年,美国的大约11,000架的无人机就发回了超过327,000个小时(约合37年)的影像。

其中大部分的数据都还来得及进行处理。所以说,人工智能在军事中的第二个主要应用就是处理数据。斯坦福大学的年度AI进步指数显示,在基于实验室的测试中,截止2015年,算法在图像分类中的性能已经超过了人类,并且在2015年至2018年之间,算法在一项更艰巨的任务——图像分割(从单个图像中挑选出多个对象)中的性能更是几乎翻了一番。

计算机视觉远非完美但也可以为人所运用。人类的视觉系统对一些细微变化并不敏感,而计算机视觉则不然。比如在一项研究中,改变熊猫图像中0.04%的像素(人类无法察觉),系统就会误判为长臂猿。

尽管存在种种弱点,但五角大楼在2017年2月得出的结论是,深度学习算法“可以以接近人类的水平执行”。据此,其成立了“Algorithmic Warfare” (算法战争)团队,代号Project Maven(专家项目),通过使用深度学习和其它技术来识别物体和可疑行动。该项目最初是用来处理在针对伊斯兰国的战争中拍摄到的影像,现在的应用则更为广泛。这样操作的目的是产生“可操作的”情报,常以导弹轰炸或特种部队破门而入而告终。

一位了解Project Maven的内部人士说,就节省时间和提供新见解而言,目前该项目对分析师的好处仍然微不足道。例如,可以看到整个城市的广角相机会发送大量误报。他说:“这些系统的本质是高度迭代的。” AI进展迅速,Project Maven只是冰山一角。

退役的英国皇家空军少将、现任职于英国Earth-i公司的Sean Corbett表示,该公司通过应用一系列卫星的机器学习算法,可以在数十个基地识别不同型号的军用飞机,其准确率超过98%(参见主图)。他说:“接下来的明智之举就是开发出一种可以自动判别物体是否正常的算法。”随着对那些基地的不断观察,该软件可以将常规部署和非正常行动区分开来,并提醒分析师注意其重大变化。

当然,算法是“杂食动物”,你可以喂给它任何类型的数据,而不仅仅是图像。去年12月,英国情报机构军情六处(MI6)负责人Alex Younger爵士表示:“大量数据与现代分析技术的结合,将使现代世界变得透明。” 2012年,美国信号情报机构-美国国家安全局(NSA)泄露的一份文件描述了这样一个项目(可放心地称之为“天网”):将机器学习应用于巴基斯坦的移动手机的数据上,从而挑选出可能是恐怖组织信使的人。例如,谁在过去的一个月里从拉合尔去过边境城镇白沙瓦,并且比平时更频繁地关闭或更换手机?2016年之前指挥英国联合部队,现已退役的Richard Barrons爵士说到:“以前,通常是指挥官提出问题,情报机构收集实体资料来寻找答案,而现在答案就在云端。”

实际上,所讨论的数据并不总是针对敌人。JAIC的第一个项目既不是武器也不是间谍工具,而是与特种部队合作,以预测其“黑鹰”直升机的发动机故障。该算法的第一版已于4月交付。空军在指挥控制机和运输机上进行的测试表明,这种预测性维护可以将计划外的工作减少近三分之一,可能会让五角大楼目前用于维护的780亿美元经费有大幅度的削减。

AI如何影响战争决策

然而,获取情报只是前提条件,关键是根据情报做出的决策。因此,AI改变传统战争的第三种方式是入主决策层。

小到排级决策,大到国家首脑决策,AI都可以参与。“北方之箭”(Northern Arrow)是以色列一家AI公司UNIQAI的产品,它可以通过处理大量数据来帮助战争指挥官部署战斗,这些数据通常包含敌方位置、武器类型、地理位置和天气状况等信息。

在传统的战争中,通常需要花费半天或一天的时间查看相关的地图和图表来处理这些数据。算法所需要的数据既来自于书本或手册,如坦克在不同海拔高度的行驶速度,也包括对经验丰富的指挥官的采访。然后算法会为那些忙碌的决策者提供选项,并附上理由。

像“北方之箭”以及美国的CADET这样的“专家系统”平台,其远快于人类的思维速度。在一次测试中,人类需花费16个小时,而CADET只需要两分钟。但是,它们倾向于采用算法上简单明了的规则遵循技术。从历史标准来看,这就是AI,但大多数专家系统采用的是确定性算法,也就是说输入相同的话,输出也相同。这种感觉,对于那些用过世界上第一台通用电子计算机ENIAC所生成的炮兵射击表的士兵来说,是再熟悉不过的了。

现实世界里,随机性常常会妨碍人们做出正确的决策,因此许多现代人工智能系统将规则遵循系统和随机性结合起来,从而应对更加复杂的决策情形。DARPA的实时对抗智能和决策软件RAID可以用来预测未来5小时内敌军的位置、动向甚至可能的情感状况。该系统基于一种博弈论思想,将问题简化为更小的游戏,从而降低了对计算能力的要求。

在04到08年间的早期测试中,RAID表现出比专业人员更准确且快速的执行力。在巴格达(注:伊拉克首都)两个小时的战斗演练中,一支队伍要与RAID或其他人为敌,而RAID不到一个小时就准确地分辨出了敌友。该软件的设计者之一Boris Stilman指出,为了模拟伊拉克叛乱分子而参与其中的退役上校们“非常害怕”这个软件,以至于“他们不再互相交谈,而是用手势来代替”。RAID正在不断改进以供军队使用。

最新的深度学习系统神秘莫测。2016年3月,由DeepMind开发的深度学习算法AlphaGo击败了围棋界最好的棋手之一李世石。比赛过程中AlphaGo几步极富创造性的走棋令专家团队感到困惑不已。次月,中国军事科学院就这场比赛举办了研讨会。军事创新专家Elsa Kania谈到:“对中国的军事战略家而言,AlphaGo胜利的启示是:在围棋这种类似于战争博弈的游戏中,人工智能的谋略较之于人类可能更胜一筹。”

从AI游戏技能中学习战争

2018年12月,由DeepMind构建的另一算法AlphaStar击败了《星际争霸Ⅱ》的顶级人类选手MaNa和TLO。不同于围棋,《星际争霸Ⅱ》是一款即时战略而非回合制的游戏,玩家的信息隐蔽性和移动自由性较围棋更高。许多军官希望AI玩游戏的天分可以移植到军事上来,从而在军事史上书下浓墨重彩的一笔。五角大楼中负责开发商业技术的国防创新部主任Michael Brown表示,利用AI实现“战略推理”是他们的重点研究方向之一。

然而,若算法聪明到人类无法理解的地步,势必会引起法律、伦理和信任方面的问题。人类的战争法则要求人们对相称性(如平民伤亡和军事利益之间)和必要性等概念作出一系列判断。而不能解释目标被选择的原因的算法很可能并不遵守这些法则。就算它遵守战争法则,人类也不可能相信这一看起来就像是魔力8号球所做出的决策。(注:魔力8号球(Magic 8-Ball)是一个随机出答案的玩具,通常有20种答案,摇一摇就随机出现一种。)

英国皇家空军指挥官Keith Dear说道:“当人工智能应用于军事战略,并计算出多种相互作用的概率推论,然后给出一个我们并不理解的行动方案时,我们该怎么做呢?”他举了这样一个例子:AI可能会建议资助Baku的一场歌剧以应对俄罗斯对摩尔多瓦的军事入侵—这是一种超现实的策略,很容易迷惑己方军队,更不要说敌人了。然而,这可能是AI掌握了一系列政治事件的结果,而这些事件不会立即被指挥官所察觉。

即便如此,他预测人们还是会接受可信性和效率之间的权衡。“即使在当今技术的限制下,AI也可能通过‘大规模近实时模拟’支持甚至取代现实世界的战争决策”。

这并不像听起来那么牵强附会。Richard Barrons爵士指出,英国国防部购买了一个模拟复杂军事环境的仿真软件,而它其实是全球超人气竞技网游《堡垒之夜》的军事版本。这款软件是由一家游戏公司Improbable和以飞行模拟器闻名于世的加拿大航空电子设备公司CAE联手打造的,其所使用的开放标准使得从实时天气数据到秘密情报的信息都可以加载到软件中。Richard爵士表示:“只要有充足的数据、移动数据的网络和处理数据的云计算,它就将彻底改变指挥和控制的方式。这将成为从国家安全委员会到战术指挥官的单一集成命令工具。”

战争最终会无人化吗?

西方国家的政府坚持认为,人类将“参与所有循环”,监督事物,但就连他们自己的官员也不相信这一说法。

指挥官Dear表示:“目前来看,从战术制定到战略决策,人类都正在逐渐跳出这一循环圈子。Kania女士表示:“中国也认为未来的战争会超出人们的认知能力。”未来出现的已不仅仅是自动化武器,而且会是自动化的战场。战争一经打响,纵横交错的AI系统会迅速锁定从导弹发射器到航空母舰等不同目标,然后设计出快速而精确的打击方式,以最有效的顺序摧毁它们。

这种规模的战争会带来怎样的后果还未可知。Zachary Davis 在最近为美国劳伦斯• 利弗莫尔国家实验室(the Lawrence Livermore National Laboratory)所写的一篇文章中指出,精准快速的打击“可能会增加突然袭击的风险,从而破坏稳定。”同样地,AI也可以用来检测突然袭击的信号进而帮助防御者抵挡此类攻击。或者,就像美国在20世纪60年代在越南丛林中大肆散布传感器一样,这样的计划可能会以昂贵而欠考虑的失败告终。然而,没有哪个大国敢冒落后于对手的风险,从这个层面上讲,是政治而不仅仅是技术在起作用。

2016年,美国的大型科技公司在AI上投资了200亿到300亿美元,而五角大楼在AI方面的支出只是其中的一小部分。虽然许多美国公司乐于和军方谈合同,如当前亚马逊和微软正在竞争国防部的100亿美元云计算合同,但其他公司则对此十分谨慎。(注:美国国防部在2018年推出了名为“联合企业国防基建”(简称JEDI)的100亿美元的云服务合同)而在2018年6月,谷歌顶着4000名员工反对卷入“用于战争的技术”的压力表示要于年底退出饱受争议的军事项目Maven,尽管这个项目足足价值900万美元。

中国具有人口优势,人口优势带来了数据优势,美国前国防部副部长罗伯特•沃克(Robert Work)今年6月警告称,如果数据是人工智能的燃料,那么中国可能拥有相对于世界其它地区的结构性优势。JAIC总干事Jack Shanahan在8月30日表达了他的担忧:我不希望看到的未来是,我们的潜在对手拥有完全由人工智能支持的力量,而我们没有。